みなさん、こんにちは!EYS-STYLE広報の泉です。

EYS-STYLEにはInspiart事業本部という、テクノロジー系の部署があることをご存知でしょうか?そこでは、音楽とAIを組み合わせたソフトやアプリの開発を行っています。

Inspiart事業本部の事業本部長九頭龍氏とエンジニアのキム氏に、私のような超文系人間でも分かるように、音楽×AIの技術や今後の展望について答えてもらう、このインタビュー企画。後編は「身近にある音楽×AIの活用例」から、音楽とAIの今後の展望を聞いていきます。

前編はこちら!↓↓

「音楽は好きだけど、AIとかテクノロジーは無理!」という方にもぜひご一読いただき、Inspiart事業本部に興味を持っていただければ幸いです。

今、身近にある音楽×機械学習を活用したもの

音楽と機械学習が組み合わされたサービスは、どんなものがあるのでしょうか?

キム:

身近な例でいうと、ジャンル識別ではないでしょうか。曲を聴いて、これはロックだとかジャズだとか、そういう識別を自動でやってくれるものはよく使われていますね。

例えば楽曲配信サービスは、研究開発にもかなり力を入れています。聴いているだけで、自分の好みの曲をどんどん提供してくれますよね。あれは機械学習で音の質を見てグループ分けし、利用者の履歴を見ながらリコメンドしていると思います。

例えばJ—POPや演歌、クラシック等いろいろな曲を聴く人がいたとして、その中にはその人なりの好みが入っています。この情報が融合されて、新しい提案が出てきたりするのでしょうか?

九頭龍:

ユーザー個人には特化していないんじゃないでしょうか。この曲とこの曲は類似性が高い、というのを見ていて。確かにその傾向を組み立てていくと、Aさんの類似性のグラフみたいなものができるとは思いますが、おそらくそこまでやっていないと思います。

キム:

正直なところ、特徴量に何を使っているのかは企業秘密で隠されているので、詳しくはわかりませんが、おそらくリズムと音程は入っているはずです。それプラス曲の長さ。例えばクラシックでコンチェルトを聴きたいのであれば、40分くらいありますよね。でもポップスだったら5分とか。特徴量は本当に色々あります。たとえば年代によっても違うでしょうね。

ここまでのお話でいくと、音楽×AIの技術で、私たちの身近なレベルまで浸透しているものは、楽曲配信サービスくらいしか思い浮かばないですね。

九頭龍:

音楽でいうとそうかもしれません。音でいうとボイスUIがありますが、音楽はまだ一般的になっていないものが多いですね。

音楽×AIの研究、まだまだ道のりは長い!?

私たちの生活レベルに機械学習と音楽の組み合わせのサービスが降りてくるには、まだ時間がかかるのでしょうか?

九頭龍:

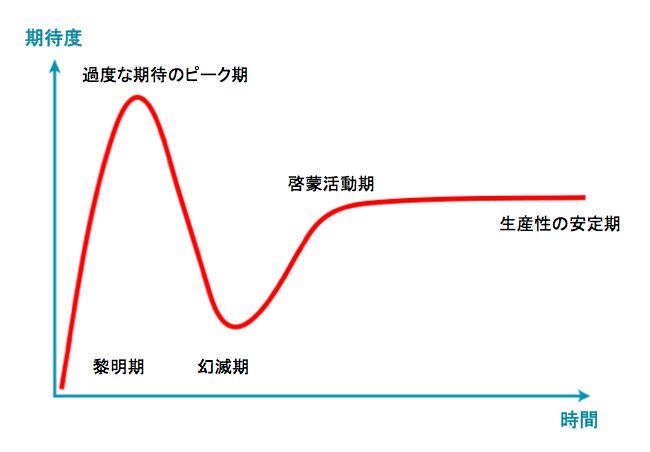

キムさんと話しているときに思ったんですが、ガートナー社のハイプサイクルってあるじゃないですか。

例えば、ボイスUIは完全に安定期に入っていますよね。

でも、音楽の分野で考えると、コードディテクションやリズムディテクションとか、そういった技術ひとつひとつは、すでに十分知られた技術なんですが、それに機械学習を掛け合わせるというと、まだ頂点(過度な期待のピーク期)すら迎えていない感じがします。

流行って廃れて、その後に一般的になるという有名なグラフですが、音楽とAIという組み合わせに関しては、流行りの時期を超えたかどうかもよく分からないんですよね。ノイズリダクションも、AIも両方とも存在するけど、それを組み合わせて「これが王道のやりかただ!」というのはまだない。ボイスUIは、今更やり方について誰もあれやこれや言いませんよね。もちろん、より好感度なマイクの開発や、ノイズ除去、話者特定技術の精度向上はまだ模索されているけれど、ボイスUIの基本機能は、いろんな方法を試して、これが良いという方式に行き着いた。音楽関連技術は、そういうAが良いとかBが良いとか、色々試す時期もまだ迎えていないように思います。

キム:

確かにそうですね。例えば、僕が一番良いと思っているテンポ分析で、テンポグラムというものがあるのですが、それも本当に最近、大学の研究成果があがったところなんです。だから、まだ大学研究の域を出ていないものがたくさんある状況なんですね。

音楽にはテンポをはじめ、色々な要素があって、それらの要素が重なって初めて音楽になるじゃないですか。だから、その様々な要素ひとつずつの解析はできてきているのだと思いますが、それらの要素を複数組み合わせていかないと、意外と使えるものにはなっていかないというのが現状だと思います。テンポだけ分析できても、残念ながら音楽にはなりませんからね。

九頭龍:

ひとつひとつの技術は音楽のパーツですからね。それが、そのまますぐにサービスにはなりません。でも研究レベルである程度の成果はあるので、ひょっとすると、各パーツごとにくぼみ(幻滅期)に滞留して出番待ちなのかもしれません(笑)

キム:

ここの幻滅期でパーツAとパーツBが組み合わさったら、また組み合わさった状態で黎明期に戻って、新しい技術としてピーク期〜幻滅期を迎える…というのを、行ったり来たりしている感じかもしれないですね。こうやって少しずつ音楽の要素が満たされていくのかも。

九頭龍:

そういう意味では、音楽×AIはまだまだこれからなのかもしれません。

キム:

あと、やはりボイスUIくらいまで安定期に入ったものが、次世代技術と呼ばれるわけじゃないですか。ですから、その啓蒙活動期の坂の前で停滞しているようなものは、まだ次世代の中にすら入ってきていない訳ですね。

九頭龍:

ゼロ世代ですね。

未来の音楽×AIサービスを予測してみる

今後、音楽×AIの技術が進化して、サービスが生み出されるとしたら、どんなものがでてくるのでしょうか?

キム:

僕が今取り組んでいるのは、自動ミキシングです。ミキシングには、エンジニア的なスキルが必要なので、プロのエンジニアに何十万というお金を支払ってお願いするミュージシャンがほとんどです。素人が自分でやっても、質の良いものは絶対にできない。

そこを機械学習を使って、自動で良い感じにミキシングしてくれるAIを開発しています。

それ以外にも、音楽教室でレッスンがAIティーチャーになったりするかもしれません。「音程が違う!」とか「リズムがはやすぎるわよ!」とか、より具体的な指導ができるようなAIが出てくるかもしれませんね。また、次世代という意味でアプリケーションになっていくのでしょうね。ティーチャーにしても、アプリにしても、音楽教育の分野では、AIの使い道はたくさんあると思います。

また、楽譜の自動演奏もより進化するはずです。現在は、先ほどお話しした通り、機械くさい音になってしまう。でも機械学習を活用すれば、より人の表現に近い音が作り出せると思います。

逆に弾いたものの楽譜化もあるでしょうね。音を検出して、リズムをとって、楽譜に落とし込んでいくようなイメージです。でも、実は楽譜化は非常に難しいんです。4拍でとったとしても、それが4拍子なのか2拍子なのかの判断って、難しいじゃないですか。

九頭龍:

音楽は、やはり表現に依存するところが多いですからね。曲を解釈しなくてはいけない部分になると、難しくなってきます。

リズム楽器が入れば、だいぶ簡単なのでしょうけど。ドラムが入れば絶対周期性が発生するので、それをもとに解釈できます。でも、人間はピアノで明確なリズム伴奏なくワルツを弾かれても、ワルツだとなんとなくわかる。あれは不思議ですよね。

キム:

そうですね、人間は理解できるんですよね。例えば、ショパンの華麗なる円舞曲の最初を聴けば、それだけで3拍子だと分かるじゃないですか。

九頭龍:

そうですね。それは限りなく意味論的なアプローチですね。AIでやりだすとかなりやっかいですけど、何が生み出されるのか非常に興味深いですね。

キム:

そうですね。AIは「この音の流れだったらビバーチェだよね」とか「こんな風に流していこう」とか、そういった表現の提案ができるのかもしれません。人のサポート的な存在として、よく日本で「弱いAI」と言いますが、音楽教育のサポートという意味で活躍するのが、次世代のAIの姿なのかな、という気もします。

AIによって、音楽を作ったり演奏したり、様々な角度からのサポートができそうですね。ありがとうございました。

いかがでしたでしょうか?「音楽×AI」について、以前より知っていただくきっかけになっていれば幸いです。

EYS-STYLEでは、これまでも音楽教室や楽器開発等、様々な角度から音楽業界を盛り上げたいと取り組んできました。Inspiart事業本部では、AIや機械学習といった、最新のテクノロジーを活用して、また違う角度から音楽業界を発展させていきたいという考えのもと、日々開発に取り組んでいます。ご興味を持っていただいた方は、ぜひInspiart事業本部のWEBサイトや、エンジニアのブログも(とっても専門的ですが読み応えばっちりです)ご覧になっていただければと思います!

EYS-STYLEのテクノロジーへの取り組みをより多くの方に知っていただくため、今後もエンジニアのインタビュー企画等行っていきたいと考えております。楽しみにお待ち下さい!